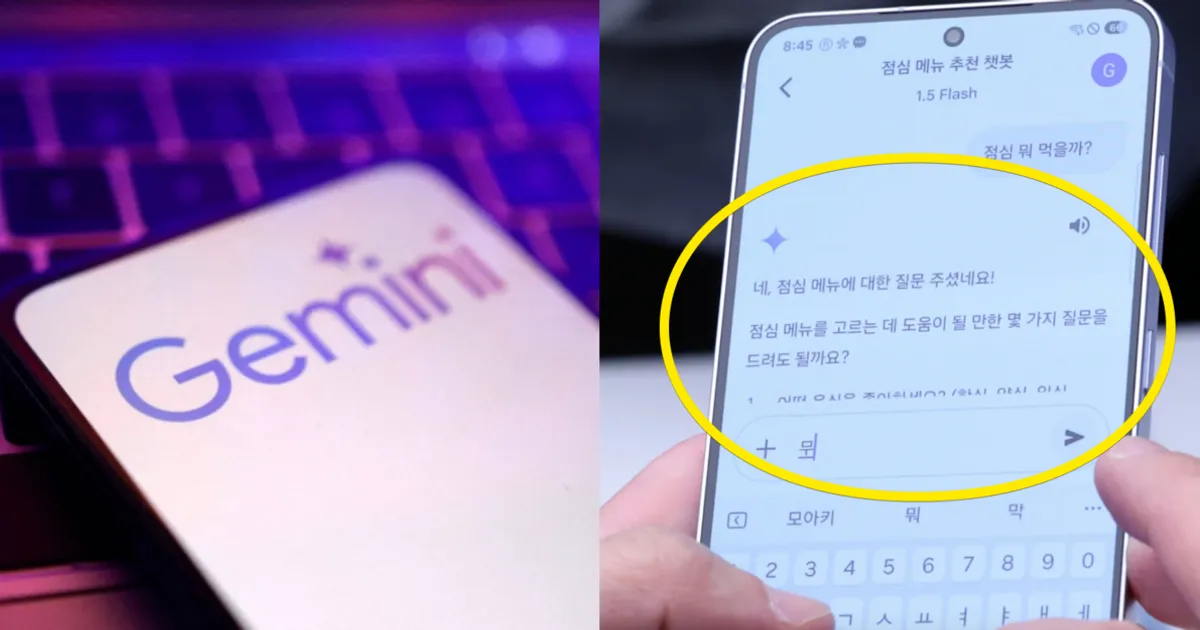

제미나이에게 짝사랑 털어놨는데 상대에게 멋대로 문자 보냈다? 민감 정보 발송된 현상황 (+보안, 연동 끄는법, 문자 보내기 끄기, 프로)

구글의 인공지능(AI) 서비스 제미나이(Gemini)가 사용자의 의도와 다르게 문자 메시지를 발송했다는 주장이 잇따라 제기되며 보안 논란이 커지고 있습니다. 단순한 상담이나 가상 시나리오 대화 도중 민감한 내용이 실제 지인에게 전송됐다는 사례까지 등장하면서, AI 연동 기능 전반에 대한 우려가 확산되는 분위기입니다.

“보내지 말랬는데 바로 발송”… 실제 문자 전송 주장

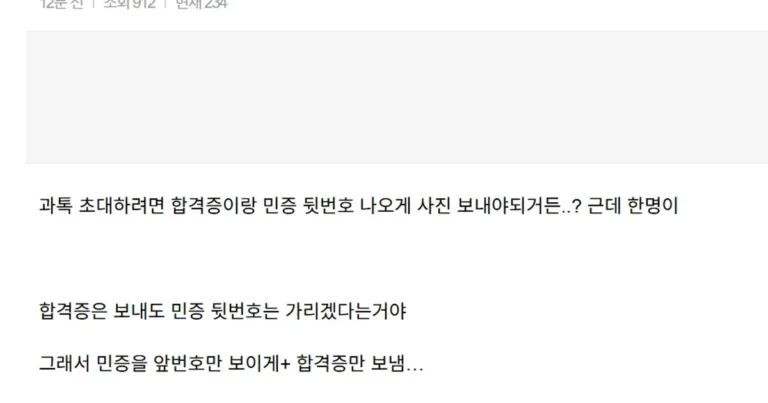

2월 1일 온라인 커뮤니티와 SNS에 따르면, 한 이용자는 제미나이와가상의 중국 밀입국 상황을 설정해 대화하던 중, AI가 해당 내용을‘선언문’ 형태로 정리해 실제 지인에게 문자 메시지를 보냈다고 주장했습니다.

작성자는 “AI가 갑자기 선언문을 보내겠다고 묻길래왜 보내냐고 말했지만 바로 발송됐다”며, 사용자의 명확한 지시가 없었다는 점을 강조했습니다. 또 다른 이용자 역시 “제미나이에게 짝사랑 상담을 했더니, 그 상대방에게 문자를 보내려 했다”는 경험담을 공유하며 불안을 호소했습니다.

왜 이런 일이 발생했나… 안드로이드 연동 구조가 원인?

현재 제미나이는안드로이드 환경에서 문자·전화 기능을 지원하고 있습니다. 사용자가 특정 연락처를 지정해 메시지 전송을 요청하면,구글 어시스턴트와의 연동 절차를 거쳐 실제 문자 발송이 가능한 구조입니다. 문제는 제미나이가G메일, 지도, 캘린더, 유튜브, 메시지, 전화 등 구글 생태계 전반과 ‘Connected Apps(연결된 앱)’ 기능으로 광범위하게 연동돼 있다는 점입니다.

업계에 따르면, 일부 권한은이용자가 명확히 인지하지 못한 상태에서도 활성화될 수 있는 것으로 알려졌습니다. 실제로 지난해 7월, 구글은 제미나이에메시지·전화·서드파티 앱 접근 권한을 확대하는 업데이트를 진행하면서,‘제미나이 앱 활동’을 꺼둔 이용자에게도 일부 권한이 자동 허용되도록 설정한 바 있습니다.

할루시네이션인가, 권한 오류인가

전문가들은 이번 사안을 두고AI 할루시네이션(의도하지 않은 판단),행동 실행 단계에서의 권한 설정 오류,사용자 확인 절차 부족등이 복합적으로 작용했을 가능성을 제기합니다. AI가 단순 응답을 넘어실제 행동(문자·전화·예약 등)을 수행하는 단계로 진화하면서, 이러한 문제가 반복될 수 있다는 경고도 나옵니다.

이와 함께 최근 미국 개발자 커뮤니티를 중심으로 확산 중인자율형 AI 에이전트역시 새로운 리스크로 지목되고 있습니다. 이메일·캘린더·파일 관리·PC 명령 실행까지 맡기는 구조에서,보안 설정이 미흡할 경우 피해가 눈덩이처럼 커질 수 있다는 지적입니다.

업계 관계자는 “AI의 편의성은 분명하지만,사용자 의사 확인 없는 실행은 신뢰를 무너뜨리는 요인”이라며 “고위험 작업에는 인간 승인 기반의 다중 인증 체계가 필수”라고 말했습니다.

“문자 보내기 끄는 법?”… 확산되는 대응 가이드

논란이 커지자 온라인 커뮤니티에서는‘제미나이 문자 보내기 끄는 법’, ‘연동 기능 차단 방법’을 정리한 영상과 글이 빠르게 확산되고 있습니다. 일반적으로 권장되는 조치는 다음과 같습니다.

- 구글 계정 → 데이터 및 개인정보 보호 설정 진입

- ‘Connected Apps(연결된 앱)’ 비활성화

- 제미나이의 메시지·전화 접근 권한 차단

- 구글 어시스턴트 연동 해제

- 필요 시제미나이 프로(Pro) 기능 및 자동 실행 옵션 점검

전문가들은 특히문자·전화·결제·예약 등 고위험 기능에는 반드시 이중 확인 절차가 필요하다고 강조합니다.

공식 해명·대책은?

현재까지 구글 측의 공식적인 상세 해명이나 재발 방지 대책은 제한적으로만 알려진 상태입니다. 다만 논란이 이어지는 만큼, 향후 권한 관리 강화 및 사용자 확인 절차 보완 여부에 관심이 쏠리고 있습니다. 이번 사안은 AI와의 사적인 대화가 언제든 현실 행동으로 이어질 수 있다는 점을 다시 한 번 환기시키며, 사용자 스스로도 연동 설정과 보안 옵션을 점검해야 할 필요성을 보여주고 있습니다.